David García-Marín – Profesor Titular de Periodismo en la Universidad Rey Juan Carlos

Resulta evidente que la desinformación alimentaria —que abarca tanto la difusión deliberada de información falsa con la intención de causar daño (disinformation) como la propagación no intencionada de contenidos erróneos (misinformation)— constituye un riesgo social significativo (Paniagua Rojano et al., 2025), con implicaciones de amplio alcance para diversos sectores e instituciones. El ámbito alimentario, como componente vital de la economía, es particularmente vulnerable a las campañas de desinformación debido a su sensibilidad inherente (Čechmánek, 2024).

La literatura científica constata que la mayoría de los mitos alimentarios y nutricionales promueven prácticas dietéticas ineficaces o potencialmente perjudiciales. La persistencia de estos comportamientos y concepciones erróneas se ve reforzada por el sesgo de confirmación (la tendencia de los humanos a otorgar credibilidad a aquella información que confirma las creencias previas o la ideología propia), el recurso a la apelación emocional y la simplificación de procesos complejos (Capocasa et al., 2026). Investigaciones previas han observado una asimilación sesgada que explica cómo los individuos se ajustan a la nueva información en función de sus creencias previas, reforzando los conceptos erróneos en lugar de corregirlos (van Stekelenburg et al., 2020; Wang, 2021), incluso en materia alimentaria.

Estudios realizados a nivel internacional han demostrado que la desinformación relacionada con los alimentos —en particular aquella vinculada con riesgos para la salud— influye de forma notable en las creencias y las acciones de los consumidores. En este sentido, la información no veraz afecta a las elecciones y comportamientos alimentarios a través de mecanismos que operan en los entornos individual, social y macroestructural, al tiempo que incide en la forma en que las personas interpretan las características intrínsecas y extrínsecas de los productos.

Esta problemática se amplifica a través de las redes sociales, que favorecen la creación de cámaras de eco y la rápida difusión de contenidos. De acuerdo con los estudios de Paniagua Rojano et al. (2025), es en los circuitos digitales donde mayor volumen de desinformación alimentaria se propaga, sobre todo en plataformas como Instagram, YouTube y Tiktok, que priorizan contenidos visuales e interactivos (Segado-Fernández et al., 2025).

volumen de desinformación alimentaria se propaga, sobre todo en plataformas como Instagram, YouTube y Tiktok, que priorizan contenidos visuales e interactivos (Segado-Fernández et al., 2025).

En palabras de Buitrago Matiz et al. (2025, p. 3), “el proceso suele seguir una cadena conductual: el usuario encuentra y comparte contenido afín, recibe retroalimentación positiva e interacción social (likes o comentarios), lo que refuerza tanto el comportamiento de búsqueda como la creencia misma”. Para estos autores, resulta fundamental la realización de auditorías de transparencia algorítmica “orientadas a evaluar cómo las plataformas priorizan o excluyen contenidos” (Buitrago Matiz et al., 2025, p. 4) a fin de contrarrestar estas cámaras de eco nutricionales. Del mismo modo, se ha demostrado que otros actores en el ámbito digital, como los influencers, desempeñan «un rol fundamental en la distribución de estos datos transmitiendo información no verificada» (Codesido-Linares et al., 2025, p. 8).

Estos procesos desinformativos pueden conllevar la activación de nuevas crisis relacionadas con la seguridad alimentaria (Vázquez & Paniagua, 2022) como consecuencia de la dificultad generalizada para tomar decisiones de consumo informadas de acuerdo con la evidencia científica (Borrajo & García-Marín, 2021), así como por la erosión de la confianza de los consumidores hacia las marcas, organizaciones (Codesido-Linares et al., 2025) y expertos.

Estudios realizados a nivel internacional han demostrado que la desinformación relacionada con los alimentos —en particular aquella vinculada con riesgos para la salud— influye de forma notable en las creencias y las acciones de los consumidores. En este sentido, la información no veraz afecta a las elecciones y comportamientos alimentarios a través de mecanismos que operan en los entornos individual, social y macroestructural, al tiempo que incide en la forma en que las personas interpretan las características intrínsecas y extrínsecas de los productos (Melios et al., 2025).

Con estos antecedentes, el objetivo general de este estudio, de carácter cualitativo, exploratorio y descriptivo, es realizar una cartografía del contenido desinformativo de carácter alimentario propagado en España, tanto desde el lado de las narrativas como desde las estrategias de verificación más frecuentemente utilizadas para desmontar este tipo de bulos.

Objetivos y metodología del estudio

En concreto, este trabajo plantea un triple objetivo:

1. Conocer cuáles son las narrativas desinformativas habituales en materia alimentaria a través del contenido verificado de los fact-checkers españoles.

2. Analizar qué estrategias de verificación utilizan estas entidades a fin de desmontar los bulos sobre alimentación.

3. En conexión con el objetivo anterior, determinar el potencial que tiene la inteligencia artificial (en adelante, IA) generativa para ayudar en la verificación de este tipo de contenido desinformativo. Dada la popularización de los chatbots de IA generativa tales como ChatGPT, Perplexity o Gemini, se considera relevante responder a la cuestión sobre su fiabilidad como verificadores automáticos de desinformación alimentaria y, en caso de que produzcan errores, mapear cuáles son los fallos más frecuentes.

Para alcanzar estos objetivos, se analizaron de forma cualitativa todos los informes de verificación sobre desinformación alimentaria de los dos principales fact-checkers españoles, Maldita.es y Newtral. Los fact-checkers o agencias de verificación “se configuran como medios de comunicación dedicados exclusivamente a la verificación de hechos, esto es, el contenido falso emitido por terceros; así como del discurso de las figuras públicas, especialmente los representantes políticos” (García-Marín, 2024, p. 2).

La elección de estas dos agencias en concreto radica en que son los verificadores con mayores recursos ubicados en el territorio español, además de erigirse como dos de los principales fact-checkers en lengua castellana. Nótese que España es el país de Europa con mayor número de agencias de verificación, y uno de los que cuenta con más entidades de este tipo a nivel mundial. Asimismo, numerosos trabajos de análisis del contenido verificado han tomado como muestras los informes de estas agencias (García-Marín & Salvat-Martinrey, 2022; Meléndez Malavé & Pérez Quintana, 2023; Fernández-Roldán et al., 2025). Además, las páginas web de ambas entidades disponen de un buscador que permite filtrar los contenidos por palabras clave, lo que facilita el acceso a la información que conforma la muestra de este estudio, a fin de acometer los dos primeros objetivos.

Para el tercer objetivo, se seleccionaron un total de 30 bulos sobre temas alimentarios presentes en la muestra analizada y verificados por ambas agencias. Estas afirmaciones fueron consultadas a los tres chatbots de IA anteriormente mencionados (GPT-4, Gemini y Perplexity), por lo que se analizaron en total 90 respuestas. Se recogió el porcentaje de aciertos y, de forma cualitativa, se anotaron las observaciones necesarias para alcanzar este tercer objetivo. Téngase en cuenta que en ningún momento se pidió explícitamente que utilizaran ningún tipo de fuente ni que las agregaran ni enlazaran, por lo que se analizaron los textos generados por defecto por parte de estos modelos de IA. Las respuestas de los tres chatbots se analizaron de forma conjunta.

Decálogo de narrativas falsas en materia de alimentación

En cumplimiento de nuestro primer objetivo, el análisis de los bulos alimentarios verificados por Maldita.es y Newtral nos lleva a establecer la siguiente taxonomía de categorías narrativas: (1) falsas promesas de curación milagrosa, (2) extrapolación indebida de evidencia preliminar, (3) falsas narrativas detox, (4) alarmas biológicas o parasitarias infundadas, (5) pánicos químicos descontextualizados, (6) tecnofobias alimentarias, (7) demonización de alimentos inocuos, (8) simplificaciones crononutricionales, (9) negacionismo epidemiológico, y (10) errores sobre conservación o procesado.

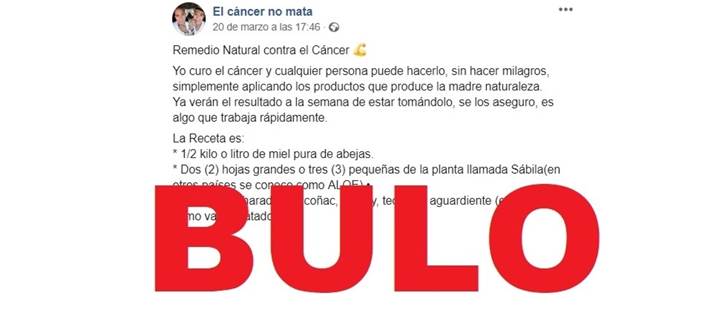

En primer lugar, resultan frecuentes las falsas promesas de curación milagrosa. Esta primera narrativa falsa atribuye a un alimento o a una mezcla de ingredientes propiedades curativas excepcionales, sin plausibilidad biológica ni respaldo clínico. Suele apelar a la esperanza y a la excepcionalidad (por ejemplo, aludiendo a propiedades curativas del cáncer). Este tipo de narrativas coincide con la identificada en investigaciones previas que aluden a las dietas milagro, asociadas con frecuencia a afirmaciones de mejoras rápidas de la salud, como uno de los principales relatos falsos sobre alimentación (Segado-Fernández et al., 2025). Un ejemplo de ello es el bulo que afirma que la mezcla de miel, aloe y whisky cura el cáncer (Imagen 1).

Imagen 1. Ejemplo de narrativa basada en falsas promesas de curación

Fuente: Maldita.es (https://maldita.es/malditaciencia/20191223/no-una-mezcla-de-miel-aloe-y-whisky-no-cura-el-cancer-ni-todos-los-tipos-de-cancer/)

La segunda categoría narrativa hallada se basa en la extrapolación indebida de evidencia preliminar, consistente en utilizarhallazgos de experimentos en fase muy primigenia o realizados exclusivamente en muestras animales para afirmar efectos terapéuticos de una determinada planta o alimento en humanos. Este tipo de desinformación obvia aspectos fundamentales, como las dosis necesarias para que el alimento funcione en humanos, su biodisponibilidad y el desarrollo de los ensayos clínicos. Encaja en esta narrativa el bulo que afirma que el kalanchoe (planta originaria de África) tiene efectos positivos contra el cáncer. La evidencia es justo la contraria: esta desinformación resulta peligrosa por los efectos adversos que su consumo puede originar en humanos.

También se han encontrado ejemplos de desinformación fundamentados en falsas narrativas detox, que sostienen que el organismo acumula toxinas que se pueden eliminar con batidos, tés o dietas depurativas. Esta categoría narrativa manifiesta un tipo de quimiofobia que establece un dualismo “producto natural versus producto químico”, así como una promesa de “limpieza interna” cuando no hay evidencia de esa supuesta depuración ni de toxinas acumuladas que tales productos eliminen.

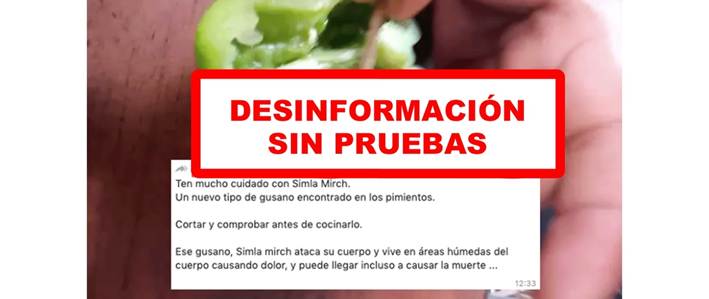

Asimismo, abundan las denominadas alarmas biológicas o parasitarias infundadas, cuyo objetivo es difundir miedo sobre parásitos o algún otro tipo de organismo mortal en alimentos cotidianos, recurriendo frecuentemente a vídeos virales descontextualizados. Ejemplo de ello es el bulo del gusano Simla Mirch en pimientos, de cuya existencia no existen pruebas (Imagen 2). Este tipo de narrativas constituyen el reverso de las teorías conspirativas que analizaremos más adelante.

Imagen 2. Desinformación sobre falsa alarma biológica / parasitaria

Fuente: Maldita.es (https://maldita.es/malditobulo/20230731/no-no-hay-pruebas-de-que-exista-un-gusano-mortal-llamado-simla-mirch-en-los-pimientos/)

Estas alarmas biológicas no son los únicos relatos que recurren al miedo vinculando determinados alimentos con problemas derivados de su consumo. Parte de la desinformación detectada se basa también en pánicos químicos descontextualizados que invocan reacciones o compuestos tóxicos reales, pero en condiciones irrelevantes para el consumo habitual.

Esta categoría desinformativa utiliza tecnicismos y lenguaje especializado (términos como arsénico, oxidación, etc.) colocándolos fuera de escala. Por ejemplo, la afirmación –ciertamente extendida– que defiende la peligrosidad de combinar vitamina C y marisco (sustentada en la conversión del arsénico pentavalente del marisco en arsénico trivalente, versión más tóxica de este compuesto) resulta exagerada ya que el riesgo exigiría cantidades enormes de estos componentes y, además, no existen casos registrados donde se hayan producido problemas en humanos.

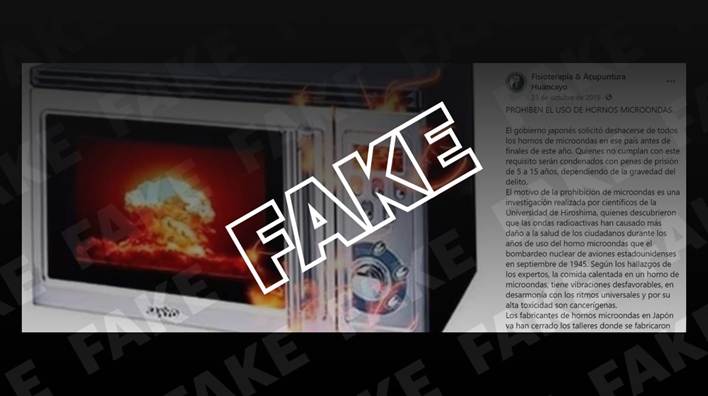

En el mismo sentido, podemos situar las tecnofobias alimentarias que demonizan tecnologías culinarias seguras a través de la confusión con procesos como la radiación ionizante (mecanismo que puede dañar las estructuras químicas y biológicas de los alimentos y modificar su ADN, alterar proteínas y lípidos o generar radicales libres) o vinculando tales tecnologías con efectos adversos inexistentes. Por ejemplo, se han detectado narrativas que vinculan el uso del microondas con la generación de procesos cancerígenos, cuando en realidad su utilización es segura: ni emplea radiación ionizante ni vuelve “radiactiva” la comida (Imagen 3).

Imagen 3. Ejemplo de narrativa basada en tecnofobia (microondas)

Fuente: Newtral (https://www.newtral.es/microondas-japon/20200223/)

Del mismo modo opera la demonización de alimentos inocuos a través de la vinculación de alimentos saludables con daños directos por su textura o acidez, todo sin sustento clínico. Uno de los bulos que podemos situar en esta categoría es el que relaciona el consumo de cierta cantidad de fruta con el desgaste de los dientes, cuando la relación es la contraria: la fruta aporta vitaminas beneficiosas para la salud bucodental.

No terminan aquí los relatos engañosos en materia alimentaria. También se identifican otros falsos mitos como las simplificaciones crononutricionales, que postulan que el momento del día altera per se el efecto metabólico de los alimentos, sin pruebas consistentes. Un ejemplo muy extendido es la afirmación de que los carbohidratos por la noche engordan más: no hay evidencia que avale este postulado.

El campo de la alimentación no escapa tampoco a las teorías conspirativas. Potenciadas al calor de la democratización de la producción de contenidos en los circuitos digitales, estas teorías ofrecen respuestas sencillas –y totalmente inventadas– a problemas complejos, e implican la presencia de un supuesto plan malvado organizado en secreto por un pequeño grupo de individuos poderosos (Bydord, 2011; Elías & Teira, 2021).

En este sentido, destacamos lo que podríamos denominar una suerte de negacionismo epidemiológico que impugna la existencia de enfermedades animales y sus brotes, sugiriendo conspiraciones económicas o diagnósticos fraudulentos. Las posturas negacionistas sobre la gripe aviar, que califican como fraude, constituyen un ejemplo paradigmático de ello (Imagen 4).

Imagen 4. Ejemplo de negacionismo epidemiológico

Fuente: Newtral (https://www.newtral.es/gripe-aviar-no-existe/20251111/).

La capacidad de la IA para crear contenido visual, sonoro y textual de manera realista ha aumentado la posibilidad de generar imágenes, vídeos o noticias con gran nivel de verosimilitud que pueden confundirse con informaciones verídicas. Además, la IA facilita el diseño y la codificación de herramientas automatizadas (bots) para la difusión masiva en los circuitos digitales de contenido falso previamente creado.

Finalmente, se observa la presencia de errores sobre conservación o procesado alimentario, que aluden a supuestas pérdidas nutricionales por congelación o calentamiento de determinados alimentos, también sin ninguna evidencia. Afirmaciones como que congelar los alimentos los hace perder nutrientes (no es así si los procesos de congelación y descongelación se realizan correctamente) o que el pan caliente sienta mal carecen de respaldo científico.

Evidencias utilizadas para la verificación

En respuesta a nuestro segundo objetivo, que pretende analizar cómo verifican los fact-checkers estas narrativas desinformativas, el estudio revela la combinación de varias estrategias y fuentes utilizadas por las agencias de verificación para desmontar este tipo de bulos. Básicamente, se pueden agrupar en dos tipos de evidencias: (1) consulta a fuentes especializadas, y (2) contra argumentación mediante hechos empíricamente demostrados.

En primer lugar, los verificadores apelan a fuentes expertas y multidisciplinares a partir de la consulta a especialistas como tecnólogos de los alimentos, dietistas nutricionistas y químicos a fin de explicar determinados procesos en los que se basa el contenido desinformativo (oxidación de aceites, extracción de taninos, química del lagrimeo con cebolla, etc.) y contextualizar recomendaciones (efectos del calor en los aceites o prácticas seguras en la cocina).

Del mismo modo, son recurrentes las consultas sistemáticas a autoridades sanitarias y reguladoras. En sus informes de verificación, los fact-checkers referencian a organismos como la Organización Mundial de la Salud (OMS), la Autoridad Europea de Seguridad Alimentaria (EFSA) o determinados ministerios y agencias nacionales a fin de, entre otras materias, clasificar patogenicidad y certificar la seguridad de alimentos concretos.

Desde el lado de la contra argumentación, los verificadores recurren a diferentes estrategias discursivas. La primera de ellas es el desmontaje mecanístico con umbrales cuantitativos. Cuando el relato desinformativo invoca reacciones reales (por ejemplo, modificación del arsénico en presencia de vitamina C), se explican valencias, dosis y escalas de exposición a fin de subrayar que el supuesto riesgo exigiría cantidades gigantescas y/o exposición prolongada, de las que no existen registros.

Otra contra narrativa verificadora habitual es la diferenciación entre tipos de evidencia con el propósito de diferenciar de forma explícita los estudios practicados en muestras animales y la evidencia clínica en humanos. Asimismo, frente a medias verdades (que resultan especialmente frecuentes en la desinformación alimentaria), se realizan correcciones con matices (ejemplo: dejar reposar el té no elimina la teína, como afirma la falsa narrativa, pero modula el perfil de sus compuestos y el efecto percibido), con el objetivo de evitar el falso dilema verdadero/falso cuando el fenómeno es complejo y matizable.

IA generativa para verificar desinformación alimentaria

IA generativa para verificar desinformación alimentaria

En el análisis de las estrategias de verificación anteriormente expuestas, se observa un uso ínfimo de herramientas de IA como apoyo para la identificación de los bulos. Tampoco son especialmente prominentes los contenidos desinformativos alimentarios generados con estos modelos algorítmicos. En todo caso, en su Comunicación sobre la Lucha Contra la Desinformación en Línea publicada en 2018, la Comisión Europea señala que la IA, sujeta al control humano adecuado, será fundamental para verificar, identificar y rastrear la desinformación. En paralelo, la Ley de Inteligencia Artificial (AI Act), propuesta en 2021, menciona los peligros de la convergencia entre IA y desinformación, sobre todo en cuestiones sensibles como son las relativas a la salud.

En efecto, tal como indican las instituciones europeas, la IA es una tecnología capaz de impactar de forma significativa en las campañas de desinformación a partir de cuatro dimensiones claramente diferenciadas: (1) la generación de contenidos falsos, (2) su amplificación y viralización, (3) la personalización del relato desinformativo y (4) la detección y verificación de este tipo de información falsa.

La capacidad de la IA para crear contenido visual, sonoro y textual de manera realista ha aumentado la posibilidad de generar imágenes, vídeos o noticias con gran nivel de verosimilitud que pueden confundirse con informaciones verídicas. Además, la IA facilita el diseño y la codificación de herramientas automatizadas (bots) para la difusión masiva en los circuitos digitales de contenido falso previamente creado.

Esta tecnología también tiene la capacidad de personalizar narrativas falsas según perfiles específicos de usuarios, aumentando el impacto de estos relatos maliciosos. Finalmente, la producción de contenido por parte de modelos generativos dificulta la tarea de verificación de la información. Los métodos tradicionales de verificación pueden resultar insuficientes frente al contenido generado artificialmente que imita con precisión el estilo y formato de la información legítima y verídica. Estos problemas se han complejizado con la democratización de la denominada IA generativa a partir del lanzamiento de ChatGPT en noviembre de 2022. Téngase en cuenta que la IA generativa es una rama de la IA que se centra en la creación de sistemas capaces de producir contenido original, como imágenes, texto, audio o vídeo, de manera autónoma.

A la vez, la IA puede ser utilizada también como herramienta para contrarrestar la desinformación. En los últimos años, ha comenzado la experimentación con sistemas algorítmicos en el denominado fact-checking automatizado o computacional a fin de mejorar las capacidades de la ciudadanía y los periodistas en su lucha contra la desinformación (García-Marín, 2022). Asimismo, la formación en el uso de estas herramientas debe ser una prioridad dada la falta de conocimiento observada, así como la aparición de problemas éticos, que subrayan la necesidad de un control continuo y supervisión de los procesos ejecutados por la IA (Noain-Sánchez, 2022).

Ahora bien, y en respuesta al tercer objetivo propuesto, ¿en qué medida la IA generativa podría ayudar en la verificación de la desinformación alimentaria? Aunque resulta tentador (y ciertamente sencillo) consultar determinadas dudas a propósito de contenido potencialmente desinformativo en el ámbito alimentario, la realidad es que estos sistemas algorítmicos están aún lejos de resultar efectivos, por lo que su utilización como fuente de verificación resulta contraindicada.

contenido potencialmente desinformativo en el ámbito alimentario, la realidad es que estos sistemas algorítmicos están aún lejos de resultar efectivos, por lo que su utilización como fuente de verificación resulta contraindicada.

De acuerdo con los datos obtenidos en este estudio, los chatbots de IA generativa (modelos como GPT-4, Gemini o Perplexity) ofrecen respuestas incorrectas en el 20,25% de las consultas. A primera vista, puede parecer un porcentaje pequeño (no en vano, parecen acertar en 8 de cada 10 consultas), pero una verificación rigurosa y seria de este tipo de contenidos no debería basarse en herramientas que, a día de hoy, manifiestan tal índice de error.

El análisis de estas respuestas incorrectas observa cuatro categorías recurrentes de error en el ámbito de la desinformación alimentaria:

1. Fallos de interpretación conceptual, presentes cuando la IA confunde relaciones causales, temporales o semánticas, lo que implica un razonamiento inductivo débil y el recurso de “atajos de aprendizaje” (shortcut learning) para producir correlatos superficiales. En uno de nuestros ejemplos, comprobamos que uno de los modelos de IA generativa afirmaba que “España lidera el consumo de pesticidas en la UE, por eso aumentan las alergias alimentarias”. En este caso, la IA asume causalidad directa y métricas absolutas, ignorando ajustes per cápita o por hectárea y la posible multifactorialidad de las alergias.

2. Dificultad para comprender matices técnicos en asuntos complejos, como los científicos, fundamentales para explicar determinados aspectos de la desinformación alimentaria. Suelen ser problemas basados en representaciones vagas de procesos normativos y jerarquías competenciales, o confusiones entre evaluación científica, autorización, control y vigilancia. En nuestras pruebas con IA, los sistemas llegaron a afirmar que los aditivos con código E los permite la UE sin controles nacionales”. En este caso, los modelos omiten que los Estados miembros realizan vigilancia y pueden implementar restricciones específicas.

3. Elección o uso inadecuado de fuentes, por no resultar pertinentes o neutrales. En algunas verificaciones, se observa el uso de medios de comunicación o blogs cuya línea editorial podría condicionar la exactitud de la información. Este tipo de error sugiere que la IA no siempre pondera la fiabilidad o la idoneidad del origen de la respuesta, lo que repercute negativamente en la calidad de la verificación.

Se observa en estos modelos una cierta optimización por disponibilidad y confusión entre autoridad y apariencia de veracidad (authority by style), consistente en la preferencia por fuentes aparentemente convincentes sin validar credenciales ni posibles conflictos de interés. Estos problemas se manifiestan en afirmaciones generadas por la IA, tales como “la carne de laboratorio es tóxica y varios países la han prohibido”, sustentada de forma falaz con declaraciones de políticos, influencers y medios opinativos, obviando agencias científicas.

4. Alucinaciones. Errores derivados de la falta de precisión o contextualización donde la IA ofrece una interpretación incorrecta, parcial, incompleta o insuficientemente argumentada del fenómeno a verificar, aunque las fuentes sean adecuadas. Por ejemplo, al revisar un bulo como “el aceite de oliva causa cáncer, según un estudio reciente”, la IA podría ofrecer una respuesta incorrecta, aunque una de las fuentes consultadas sea un estudio válido publicado por una revista científica.

5. Error de enfoque. Consiste en la falta de comprensión del prompt, lo que lleva a la IA a responder a una pregunta distinta de la formulada o centrarse en un aspecto irrelevante del problema. Esta falta de comprensión se puede establecer mediante diferentes mecanismos subyacentes: (1) prompt misalignment, cuando el modelo entiende instrucciones que no están alineadas con el objetivo real, (2) falta de desambiguación, cuando la petición del usuario tiene varias interpretaciones posibles y el sistema no hace preguntas aclaratorias, rellena huecos por su cuenta y se equivoca de camino, y (3) interpretación incorrecta de la intención del usuario (intent parsing), es decir, el sistema no identifica qué intención concreta tiene el usuario ni prioriza las entidades relevantes del prompt. En una de nuestras pruebas, cuando se le pregunta “¿permite la normativa vender verduras irradiadas sin indicarlo en la etiqueta?”, la IA contesta con argumentos generales sobre seguridad sin abordar de forma directa el requisito de etiquetado.

Observaciones finales

Los resultados de este estudio exploratorio permiten obtener algunas claves que podrían resultar útiles en futuras acciones de alfabetización mediática e informacional específicas sobre desinformación alimentaria. En primer lugar, las categorías narrativas identificadas en el análisis podrían servir como base para diseñar estrategias de comunicación y de anticipación (prebunking) de relatos desinformativos frecuentemente utilizados en el ámbito de la alimentación.

Uno de los aspectos emergentes del trabajo es que estos bulos alimentarios se sustentan en heurísticos cognitivos claramente detectables que aportan credibilidad a los relatos falsos o engañosos. Los más frecuentes son la atracción por lo natural, la ilusión de control mediante rituales domésticos (presente, por ejemplo, en los bulos sobre trucos de cocina para mejorar o potenciar determinadas propiedades de los alimentos) o pruebas visuales anecdóticas, así como la opacidad técnica de procesos químicos o microbiológicos.

Asimismo, la mayoría de las narrativas desinformativas mezclan aspectos verídicos con datos falsos, lo que complejiza su verificación. Esta conclusión resulta coincidente con estudios previos: “Lejos de basarse exclusivamente en falsedades absolutas, este tipo de desinformación se articula principalmente a través de contenidos engañosos y contextos falsos, que combinan elementos verídicos con interpretaciones distorsionadas y apelaciones emocionales” (Paniagua Rojano et al., 2025, p. 63). Esto obliga a producir (contra)narrativas verificadoras basadas en la explicación de matices y, por tanto, en la corrección sin negar o desmentir en bloque.

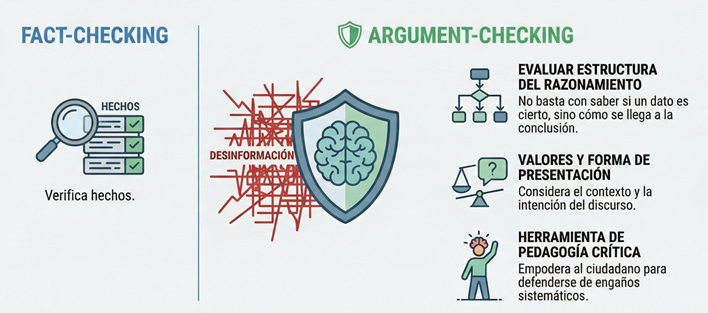

Por ello, frente a la verificación tradicional o fact-checking, emerge el concepto de argument-checking como un procedimiento sistemático para analizar, reconstruir y evaluar los argumentos que se encuentran en el discurso desinformativo en el ámbito de la alimentación. De acuerdo con Brave et al. (2022), a diferencia del fact-checking (verificación de hechos), el argument-checking se centra en evaluar la estructura del razonamiento, ya que no solo pretende verificar si los hechos son ciertos, sino cómo se utilizan esos hechos para llegar a conclusiones, considerando también los valores y la forma en que se presenta la información. En definitiva, el argument-checking se propone como una herramienta de pedagogía crítica para que los ciudadanos puedan defenderse de la desinformación (Imagen 5).

Imagen 5. Definición de argument-checking

Nota. Esta infografía ha sido creada con la herramienta de IA NotebookLM utilizando información de este artículo y con revisión del autor.

Fuente: elaboración propia.

Desde el lado de la verificación, este trabajo muestra la relevancia de las figuras de autoridad epistémica (la consulta a expertos), lo que se alinea con la necesidad de que los fact-checkers no solo presenten información basada en evidencias, sino que también refuercen su imagen pública como fuentes imparciales y fiables (Von-Polheim, 2026).

En este sentido, resulta esencial la participación en el discurso público de los profesionales de la nutrición, los científicos, los investigadores y los expertos en alimentación en un entorno caracterizado por la sobreabundancia de datos, a fin de mitigar la desinformación en este ámbito (Diekman et al., 2023).

La literatura científica demuestra que los contenidos propagados en redes sociales relacionados con la nutrición procedentes de fuentes fiables, como dietistas y organizaciones sanitarias, presentan una mayor precisión, lo que pone de relieve la necesidad de incrementar la visibilidad de estas voces autorizadas (Lambert et al., 2017; Charbonneau et al, 2022). Sin duda, estos expertos pueden desempeñar un papel fundamental en la evaluación de la información sobre alimentación y nutrición a la luz del conjunto de evidencias científicas disponibles.

Finalmente, resulta fundamental mantener un equilibrio entre el rigor científico y el uso de un lenguaje accesible para llegar a audiencias más amplias e inclusivas (Gibson et al., 2020). Por ello, la colaboración entre plataformas de verificación, científicos y organismos reguladores podría maximizar el impacto de las estrategias comunicativas contra la desinformación alimentaria.

Agradecimientos

Este trabajo forma parte del proyecto “Desafíos, usos y limitaciones de la IA en el fact-checking y la lucha contra la desinformación” (DESAF_IA) (Ref. 2024/SOLCON-135623) financiado por la convocatoria de Proyectos IMPULSO a la investigación de la Universidad Rey Juan Carlos (2024).

Referencias

Borrajo, I., & García-Marín, D. (2021). Fake news y desinformación en el ámbito agroalimentario: una revisión crítica. Revista Mediterránea de Comunicación, 12(2), 45-60. https://doi.org/10.14198/MEDCOM2021.12.2.3

Brave, R., Russo, F., & Wagemans, J. (2022). Argument-checking: A critical pedagogy approach to digital literacy. En F. Ciracì, G. Miglietta, & C. Gatto (Eds.), AIUCD 2022 – Culture digitali. Intersezioni: filosofia, arti, media: proceedings (pp. 245–248). Associazione per l’Informatica U anistica e la Cultura Digitale. https://doi.org/10.6092/unibo/amsacta/6848

Buitrago Matiz, J. J., Guerrero, F. F. M., Rodríguez, L. S. V., Tovar, C. A. V., Díaz, F. I. G., & Palencia-Sánchez, F. (2025). El rol de los algoritmos de redes sociales en la creación de «cámaras de eco» de desinformación nutricional. SocArXiv. https://doi.org/10.31235/osf.io/ub9hk_v1

Bydord, J. (2011). Conspiracy Theories: A Critical Introduction. Palgrave-Macmillan.

Capocasa, M., Venier, D., Venier, B., & Chiarla, C. (2026). Exploring nutritional myths and fake news: Impact and counteractions. Clinical Nutrition ESPEN, 72, 102947. https://doi.org/10.1016/j.clnesp.2026.102947

Čechmánek, K. (2024). Disinformation, Misinformation and the Agri-Food Sector. EU Agrarian Law, 13(1), 21-27. https://doi.org/10.2478/EUAL-2024-0003

Charbonneau, E., Mellouli, S., Chouikh, A., Couture, L.J., & Desroches, S. (2022). The Information Sharing Behaviors of Dietitians and Twitter Users in the Nutrition and COVID-19 Infodemic: Content Analysis Study of Tweets. JMIR Infodemiology, 2(2), e38573. https://doi.org/10.2196/38573

Codesido-Linares, V., Hernández-Herrera, M., García-Guardia, M.L. (2025). Revisión Sistemática de Literatura sobre la Difusión de Desinformación Relacionada con la Nutrición en Redes Sociales. Revista española de nutrición comunitaria, 31(4). https://doi.org/10.63474/renc.v31i4.14

Diekman, C., Ryan, C. D., & Oliver, T. L. (2023). Misinformation and disinformation in food science and nutrition: Impact on practice. The Journal of Nutrition, 153(1), 3–9. https://doi.org/10.1016/j.tjnut.2022.10.001

Elías, C., & Teira, D. (2021). Manual de periodismo y verificación de noticias en la era de las fake news. UNED.

Fernández-Roldán, A., Elías, C., Santiago-Caballero, C., & Teira, D. (2025). Can We Detect Bias in Political Fact-Checking? Evidence from a Spanish Case Study. Journalism Practice, 19(7), 1441–1459. https://doi.org/10.1080/17512786.2023.2262444

García-Marín D. (2022). Modelos algorítmicos y fact-checking automatizado. Revisión sistemática de la literatura. Documentación de las Ciencias de la Información, 45(1), 7-16. https://doi.org/10.5209/dcin.77472

García-Marín, D. (2024). Periodismo contra la desinformación. Proceso y estructura de las verificaciones en el fact-checking. Infonomy, 2(2). https://doi.org/10.3145/infonomy.24.026

García-Marín, D., Salvat-Martinrey, G. (2022). Viralizar la verdad. Factores predictivos del engagement en el contenido verificado en TikTok. Profesional de la información, 31(2), e310210. https://doi.org/10.3145/epi.2022.mar.10

Gibson, S., Adamski, M., Blumfield, M., Dart, J., Murgia, C., Volders, E., & Truby, H. (2020). Promoting evidence based nutrition education across the world in a competitive space: Delivering a massive open online course. Nutrients, 12(2), 344. https://doi.org/10.3390/nu12020344

Lambert, K., Mullan, J., Mansfield, K., Koukomous A., & Mesiti, L. (2017). Evaluation of the quality and health literacy demand of online renal diet information. Journal of Human Nutrition and Dietetics, 30(5), 634-45. https://doi.org/10.1111/jhn.12466

Meléndez Malavé, Natalia & Pérez Quintana, Paula (2023). La verificación de bulos relacionados con el feminismo: un análisis de los desmentidos sobre género publicados en Maldita.es y Newtral. Signo y Pensamiento, 42. https://doi.org/10.11144/Javeriana.syp42.vbrf

Melios, S., Asimakopoulou, A.A., Greene, C.M., Crofton, E., Grasso, S. (2025).

Food-related fake news, misleading information, established misconceptions, and food choice. Current Opinion in Food Science, 63, 101309,

Noain-Sánchez, A. (2022). Addressing the Impact of Artificial Intelligence on Journalism: the perception of experts, journalists and academics. Communication & Society, 35(3), 105-121. https://doi.org/10.15581/003.35.3.105-121

Paniagua Rojano, F. J., Vegas García, L., & Fortes Martínez, T. (2025). Desinformación en el sector alimentario. Estudio de casos publicados en Maldita, Newtral y EFE Verifica. Revista Internacional de Relaciones Públicas, 15(30), 45-66. https://doi.org/10.5783/revrrpp.v15i30.913

Segado-Fernández, S., Jiménez-Gómez, B., Jiménez-Hidalgo, P.J., Lozano-Estevan, M.C., Herrera-Peco, I. (2025). Disinformation about diet and nutrition on social networks: a review of the literature. Nutrición Hospitalaria, 42(2), 366-375. http://dx.doi.org/10.20960/nh.05533

van Stekelenburg, A., Schaap, G., Veling, H., & Buijzen, M. (2020). Correcting misperceptions: The causal role of motivation in corrective science communication about vaccine and food safety. Science Communication, 42(1), 31–60. https://doi.org/10.1177/10755470198982

Vázquez, M. A., & Paniagua, F. (2022). Comunicación en tiempos de posverdad: desafíos éticos para las organizaciones. Revista de Comunicación, 21(1), 187-205. https://doi.org/10.26441/rc21.1-2022-a9

Von-Polheim, P. (2026). A Thematic Analysis of Hoaxes Debunked by Newtral and Maldita Alimentación. Journalism and Media, 7(1), 45. https://doi.org/10.3390/journalmedia7010045

Wang, Y. (2021). Debunking misinformation about genetically modified food safety on social media: Can heuristic cues mitigate biased assimilation? Science Communication, 43(4), 460–485. https://doi.org/10.1177/10755470211022024